Ejemplo de procesado en un cielo muy contaminado.

Ejemplo de procesado en un cielo muy contaminado.

El presente artículo lo escribiré, al mismo tiempo que proceso, se trata de la Crescent Nebula (NGC 6888) en la constelación del Cisne, un objeto muy popular entre los aficionados a la astrofotografía a partir de finales de la primavera que es cuando comienza a ganar altura al principio de la noche.

Cabe decir que está hecha desde el balcón de mi casa, donde por desgracia, tengo unas condiciones de nula oscuridad y fuerte contaminación lumínica provocada por el puerto comercial de Castellón que lo tengo a escasos 200 m mirando al este, 200 m mirando al sur tengo el núcleo urbano del Grau de Castelló, y si miro hacia el noreste tengo un campo de fútbol que como es normal encienden las luces para poder entrenar de noche, también tengo todo el gran Benicàssim playa y un poco más lejos Oropesa de Mar, para que os hagáis una idea de la distancia, en Oropesa hay una torre de radar que muchas veces la uso para enfocar mis cámaras.

Apunte hacia donde apunte, el Bortle varía de 7 a 9 y de ahí no me escapo. Para poder sacar algo medio decente, he estimado que se necesitan al menos 20 horas de integración acumulada, de ahí en adelante, bien, pues la idea era ir acumulando exposición, pero el mal tiempo ha hecho que el objeto ya esté demasiado alto y no pueda continuar con él, he de decir que el techo del ático que tengo encima, me imposibilita tirar a más de 65° de altitud, y era procesarla ahora o dejarla hasta el año que viene.

Aprovecharé para ir documentando todo lo que haga, incluidos los errores y las rectificaciones, también expondré los motivos de mis decisiones.

La imagen está tomada con un reflector newton Skywatcher Quattro 150P, o sea 600 mm a f/4, con el corrector de coma que no modifica la relación focal (1X). La cámara es una ZWO ASI 533 MC Pro, una cámara dedicada, a color, refrigerada a 0°, hacía muchísimo calor esos días y no quería exigirle tanto esfuerzo a la refrigeración. Son 73 tomas de 300″ cada una a 101 de ganancia (6h), con el filtro L-eNhance de Optolong.

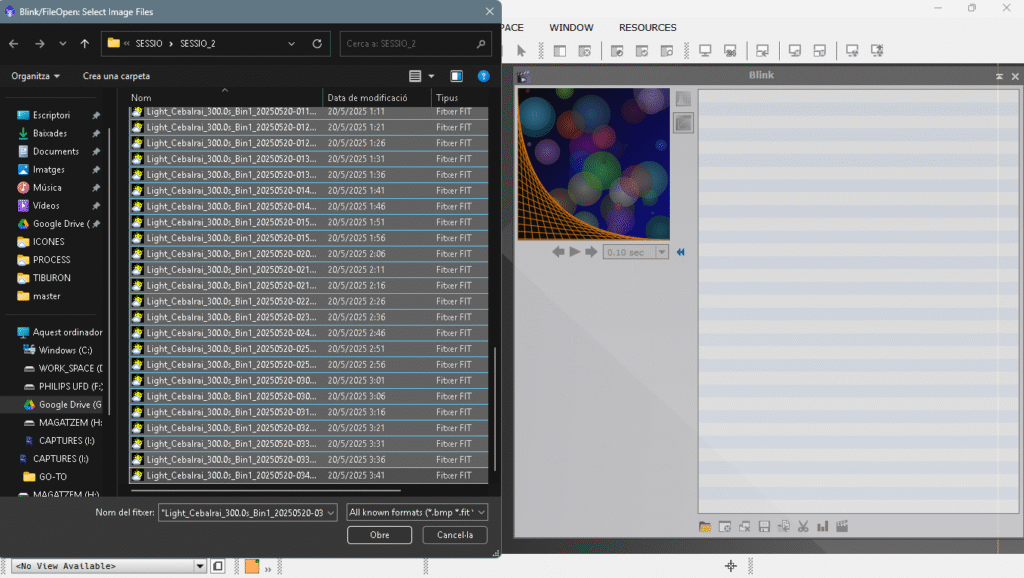

Lo primero de todo es abrir Blink para revisar todas las imágenes y descartar las malas.

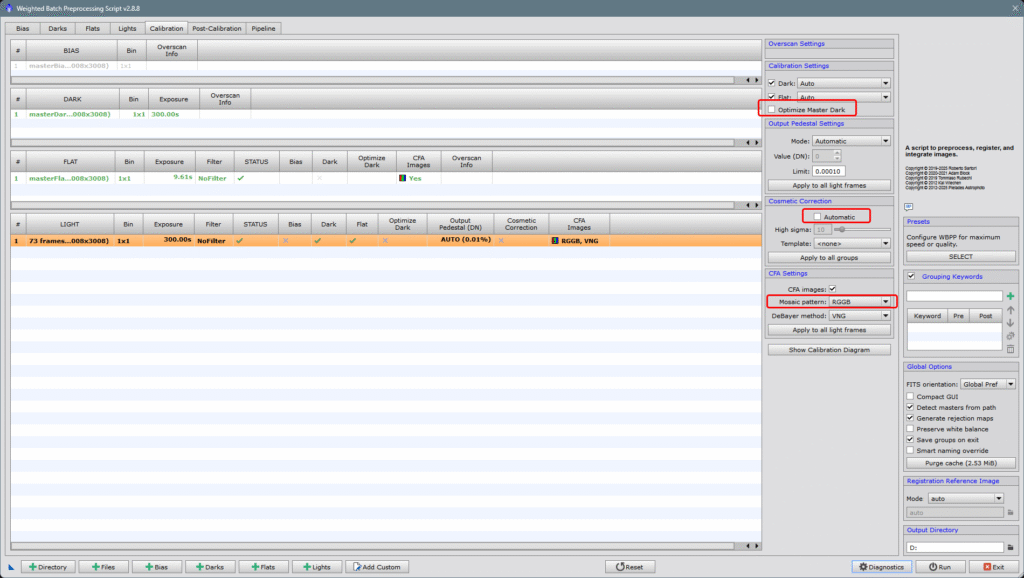

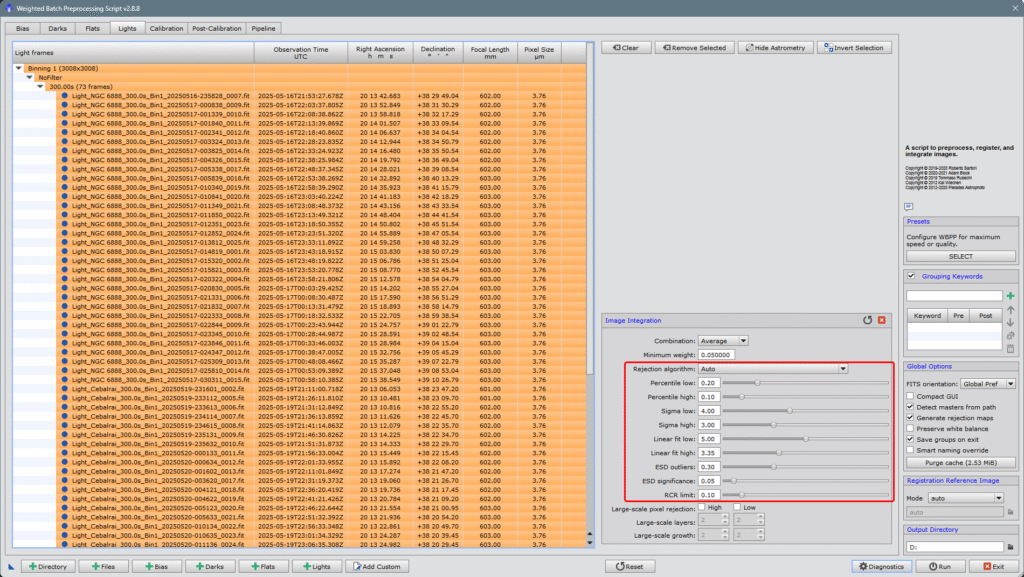

Una vez descartadas, abrimos WBPP y añadimos todos los lights (fotos del objeto), darks (tomas oscuras), y bias (darks a la máxima velocidad), lo he hecho por separado porque tanto los darks como los bias, los tengo en una librería hecha para la 533. Si lo hubiera tenido todo en una carpeta, solo hubiera hecho falta hacer clic en Directory y seleccionar la carpeta raíz y ya hubiera ido cada tipo de imagen a su lugar correspondiente. Si nos fijamos en el panel de la derecha (se abre seleccionando sobre la barra de los lights), no he activado Optimize Master Dark porque todos los darks están hechos a la misma temperatura y duración que los lights, por este mismo motivo he desactivado la Cosmetic Correction y he cambiado el patrón de Bayer a RGGB porque conozco la arquitectura del sensor de la 533 y sé seguro que es ese el RGGB.

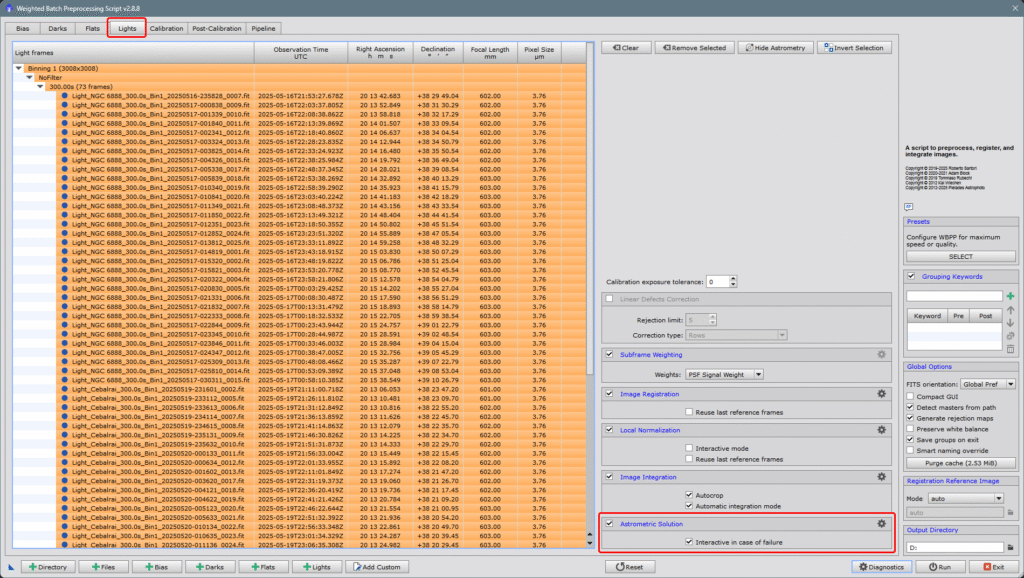

Ahora vamos a la pestaña superior para acabar de configurar cómo queremos que WBPP trabaje los lights. El parámetro más importante para mí, es el Image Integration, ya que determinará qué función se usará para combinar las 73 fotos, en este caso hubiera elegido alguna función sigma, más que nada porque en un cielo tan contaminado es más fácil tener píxeles discordantes debido a la CL (contaminación lumínica), pero al revisar el modo automático, he visto, que los parámetros de rechazo, son similares a los de una función sigma clip, incluso mejores, así que lo he dejado en Auto.

También en Astrometric Solution, he dejado activado el modo manual en caso de error (Interactive in case of failure)

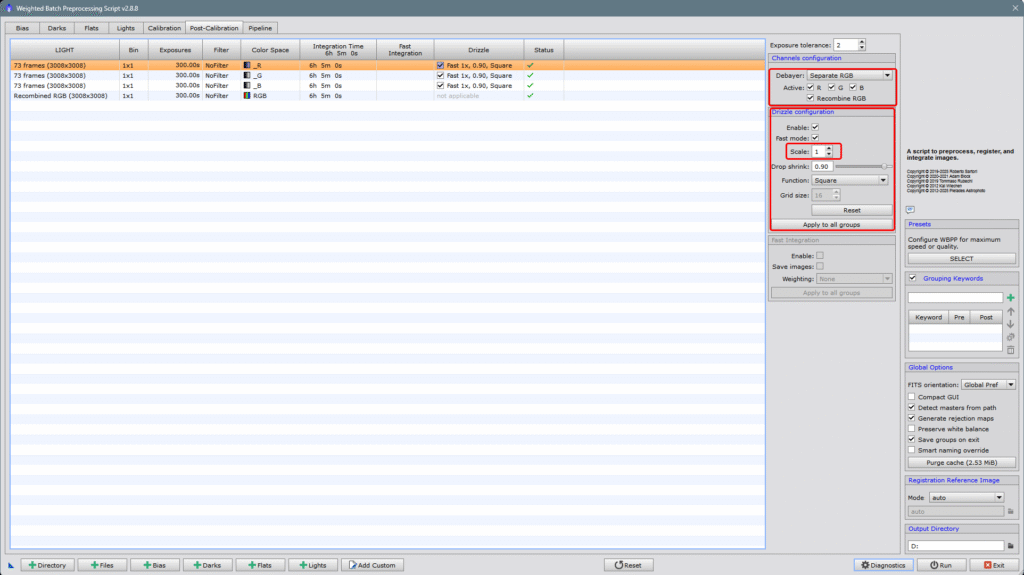

En el post-calibrado he elegido Separate RGB y el posterior Recombine RGB, en cuanto al Drizzle (explicado en el artículo del WBPP) me he decantado por ser conservador y no maltratar mi viejo ordenador, que no más es un i3 estándar, así que no más lo he puesto a 1X (a la próxima probaremos a 2X).

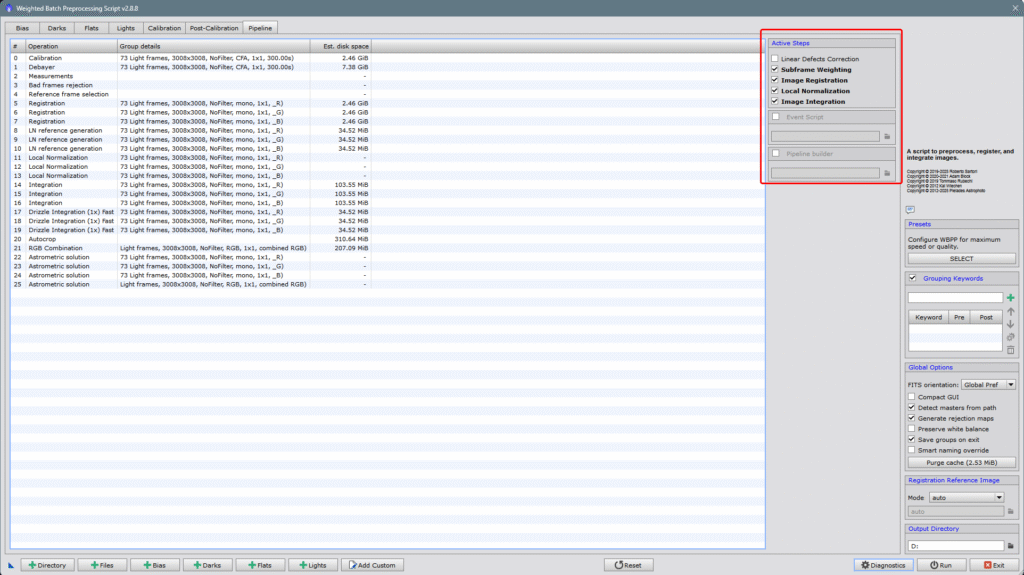

Recordemos que desde la ventana del Pipeline (índice de procesos en orden), podemos activar/desactivar todo lo que queramos

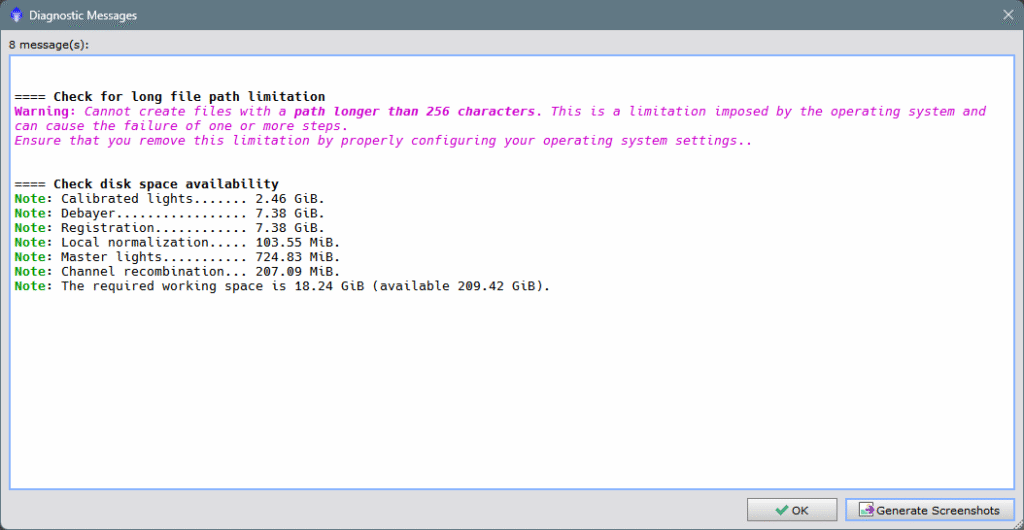

Ya solo falta revisar que esté todo bien con el botón Diagnósticos, hacemos clic y nos muestra una ventana informativa que nos avisa que los nombres de los archivos no podrán ser superiores a 256 caracteres (cosas de Windows), también nos dice cuál es el espacio que necesita para cada operación, y finalmente, cuál es el peso global de todo el proceso y cuál es el espacio que tenemos en la unidad donde le hemos dicho que haga todo el calibrado, en este caso la unidad D:

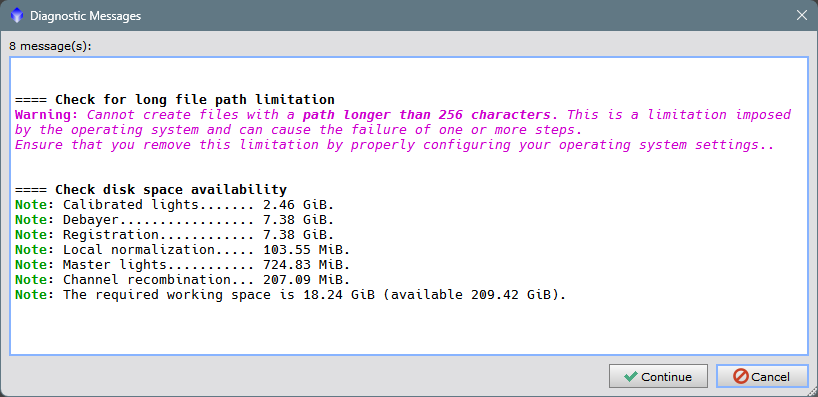

Ahora si hacemos clic en Run, nos vuelve a avisar de lo mismo de antes por si queremos hacer algún cambio de última hora, y si le damos a Continue, comenzará todo el proceso a rodar.

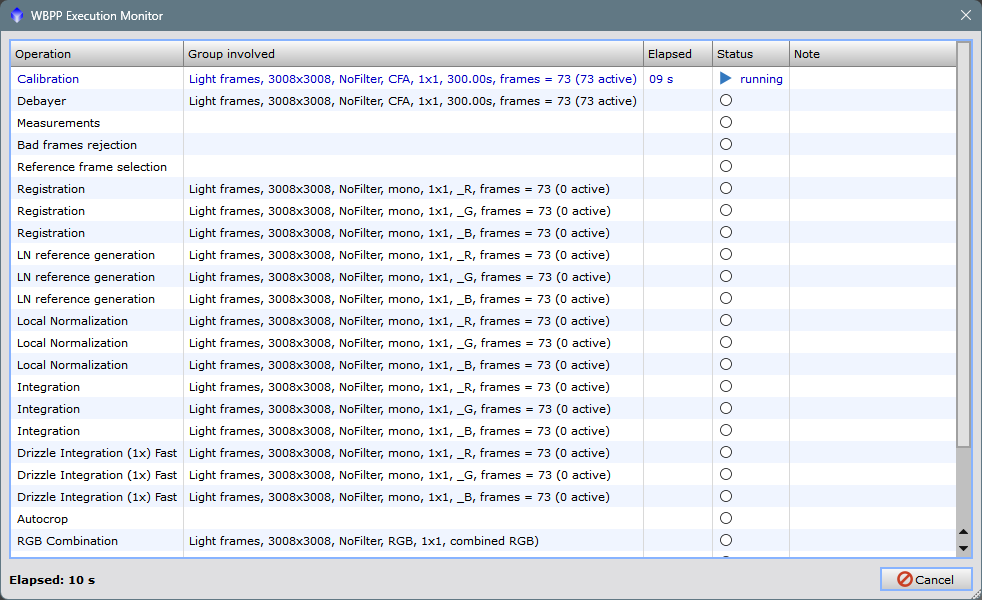

En esta pantalla podemos hacer el seguimiento detallado en tiempo real de todo el proceso de calibrado, lo podremos parar en cualquier momento, eso sí, si lo paramos, tendremos que empezar otra vez desde el principio.

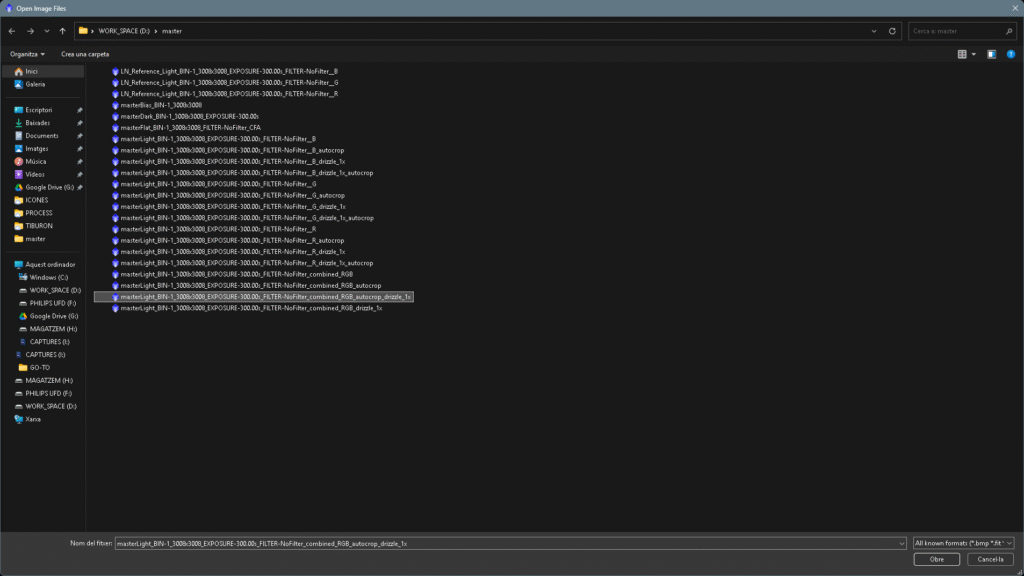

Después de 5 horas de trabajo, ya tenemos los másters en la carpeta de destino, nos ha sacado los másters canal por canal, enteros y con el autocrop, con drizzle 1x con y sin autocrop, el máster combinado de RGB, con autocrop y sin y con drizzle 1x y sin, en total 16 másters para que elijamos el que más nos guste je je.

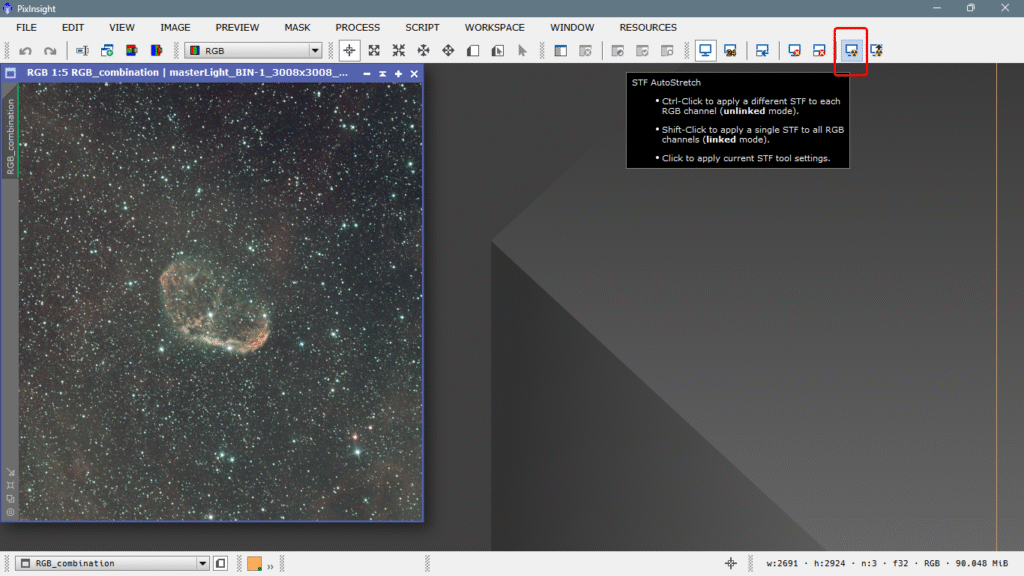

Obviamente abriremos el combined_RGB_autocrop:drizzle_1x

Lo primero que hago es revisarlo con el STF para ver que no hay nada extraño

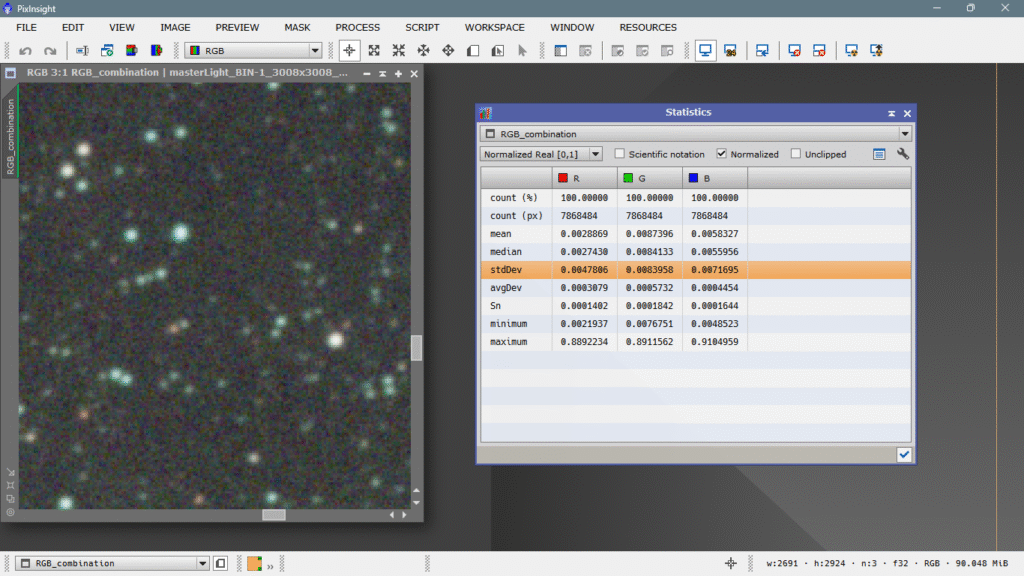

espués intento estimar el nivel del ruido de fondo leyendo las estadísticas, si el valor de la desviación estándar es muy elevado respecto de la media, quiere decir que la imagen es muy ruidosa, en imágenes aún lineales, valores por debajo de 0.01, son valores bastante razonables, como podemos ver en nuestra imagen, a pesar de las condiciones, está en un nivel de ruido bastante aceptable, tanto de ruido térmico o de corriente oscura (de la misma cámara), como fotónico (ruido del mismo cielo, CL, etc.)

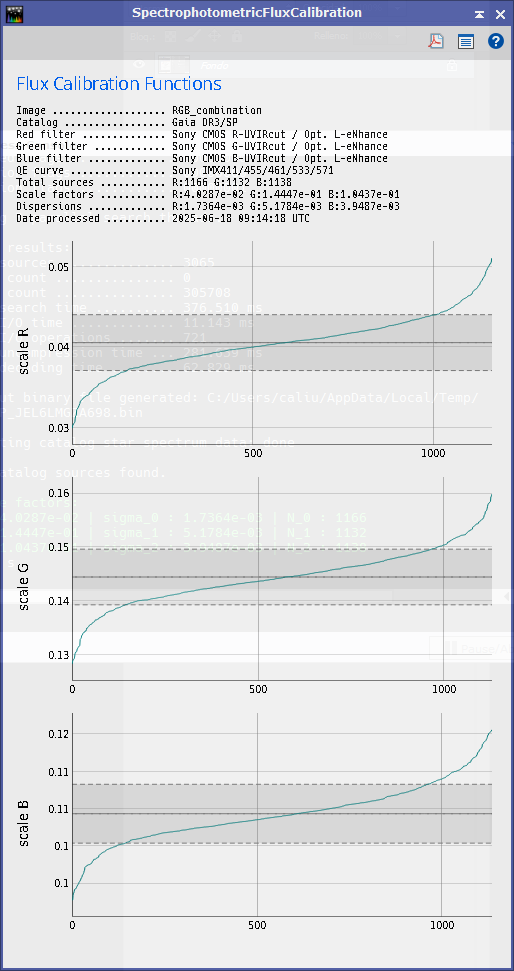

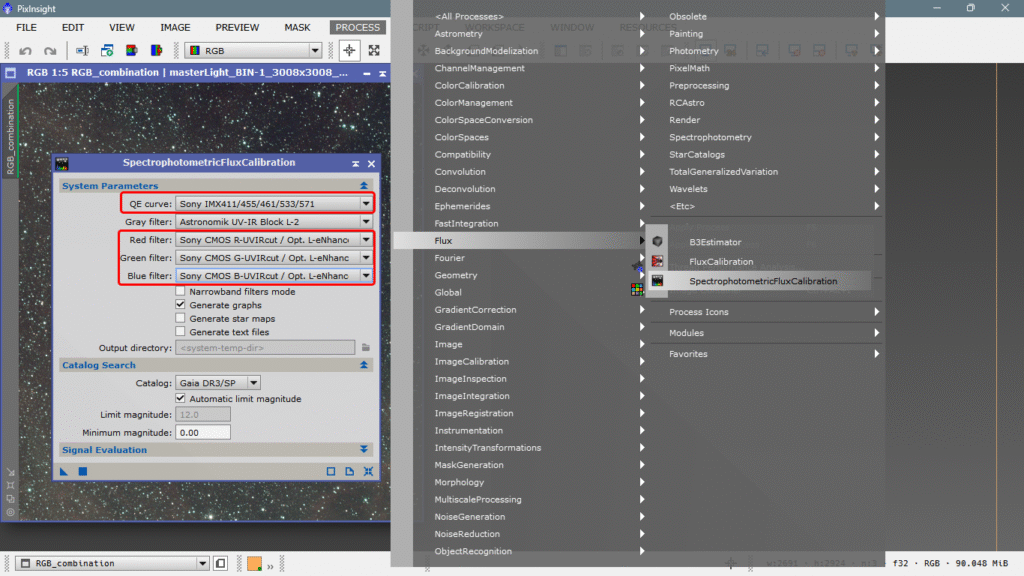

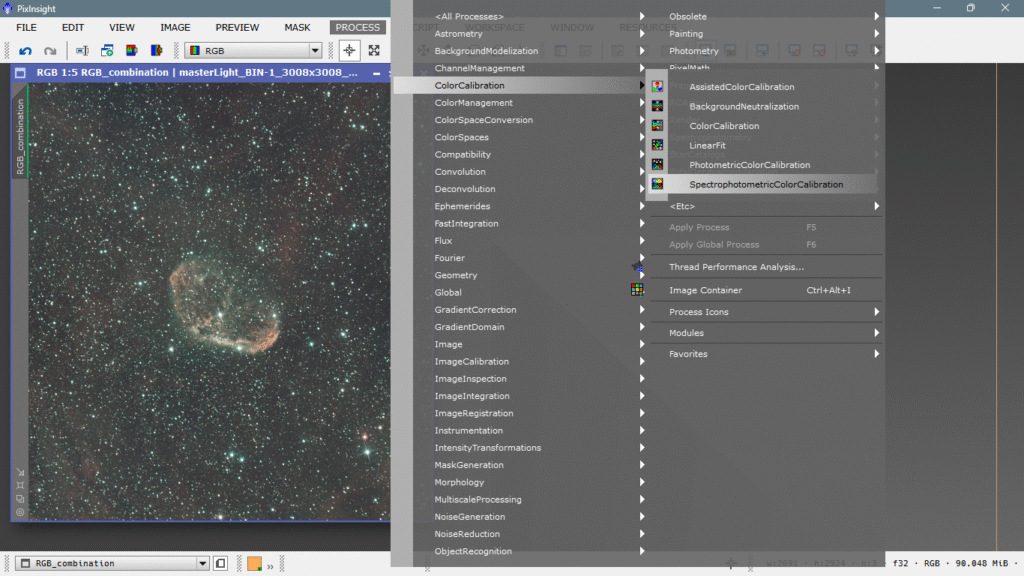

Pues bien, vamos a calibrar el flujo de luz global de la imagen, con la herramienta SPFC que ya hemos visto en una entrada anterior LINK

Abrimos la herramienta y la configuramos, en QE Curve le ponemos el modelo exacto de sensor que lleva la ASI 533 MC, el IMX533, Gray filter se ignora, ya que es una cámara a color, y en los canales ponemos el tipo de sensor y el filtro que lleva encima, es decir, un sensor CMOS de la marca Sony + un filtro Optolong L-eNhance, introducimos el preset canal por canal y le damos al cuadro azul del Apply o lanzamos el triángulo sobre la imagen.

Una vez acabe, nos mostrará la gráfica del flujo total de iluminación global canal por canal, comparado con el catálogo GAIA DR3/SP, los valores de la zona gris son los que usará el programa para calcular el valor de la media de luz de la imagen, y añadirá esa metadata a la cabecera del archivo para que lo pueda usar cualquier herramienta que lo necesite, como por ejemplo MGC o SPCC (artículo en construcción).

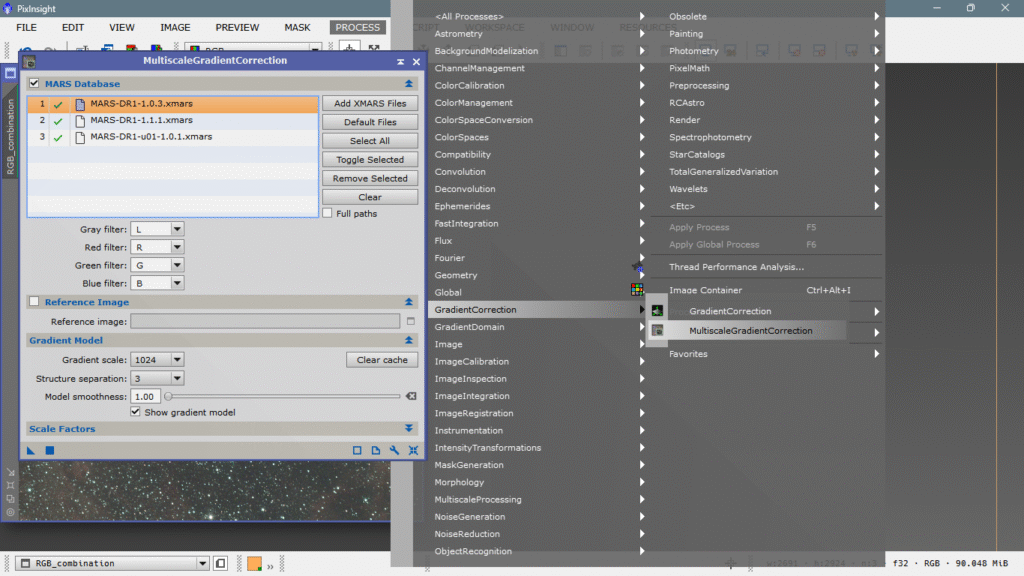

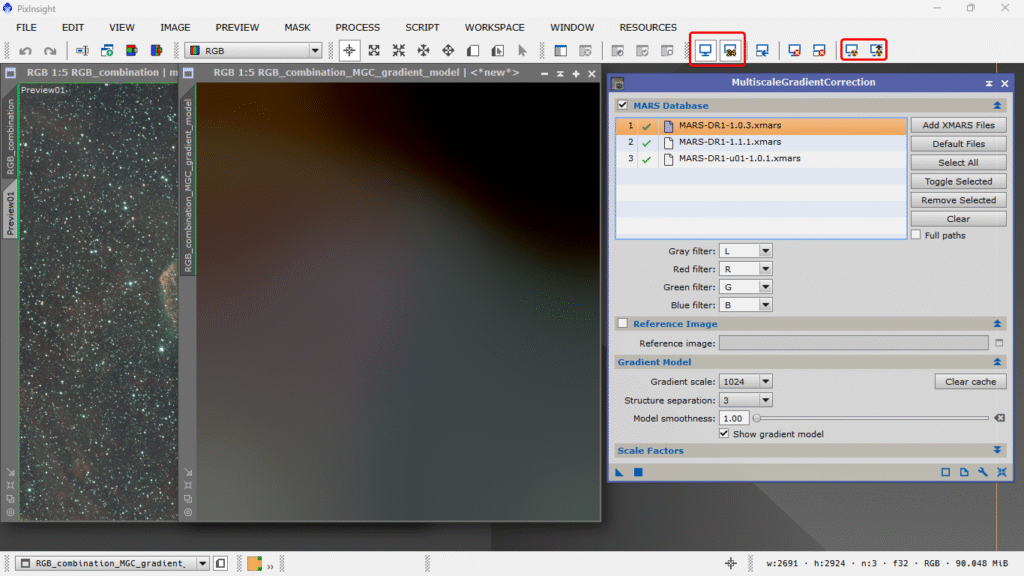

Seguidamente ha llegado el momento de eliminar los posibles gradientes que tenga la imagen. Para hacerlo, usaremos la herramienta llamada Multiscale Gradient Correction o MGC que también hemos explicado qué es y cómo funciona, en una entrada anterior LINK

Abrimos la consola para configurarla, como la tenemos configurada de otras veces, simplemente elegiremos el último catálogo actualizado de MARS (gran tarea hecha por la gente del PTeam, especialmente Vicent Peris y Alicia Lozano).

Como a pesar de todo, la imagen no se ve extraña ni con gradientes exagerados y con bastante información de fondo, pues vamos a aplicar los parámetros por defecto y a observar el resultado y sobre todo el modelo de gradiente, recordemos tener activado el Show gradient model

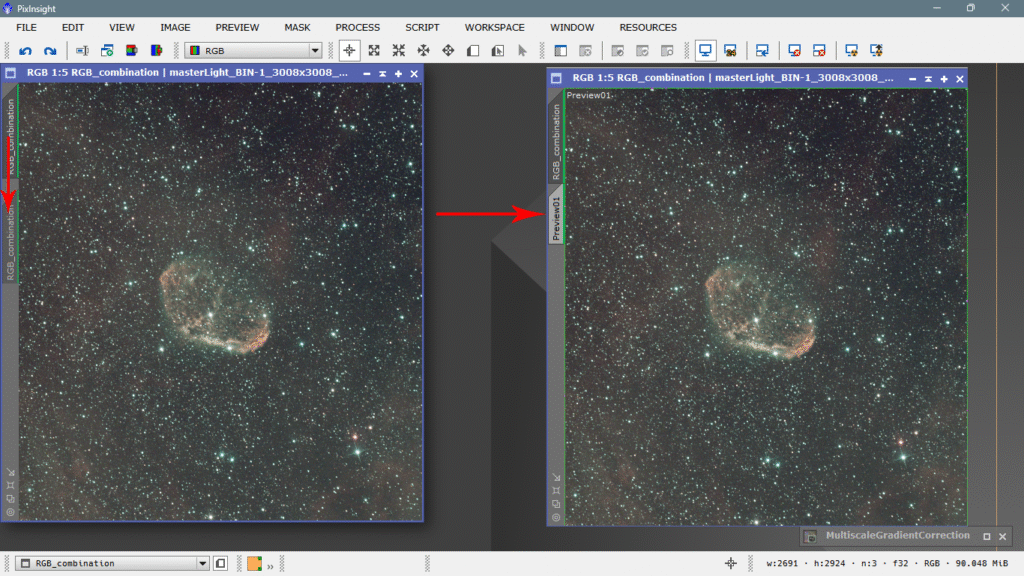

Un «truquito» de procesado, consiste en hacer un preview de toda la imagen sobre la bandeja lateral izquierda, simplemente deslizando la pestaña del nombre de la imagen encima, así obtendremos un preview muy necesario para ver el antes/después con mucha más agilidad. Lo hacemos

Al modelo de gradiente que lo estiramos con STF y lo ponemos a 24 bits para poder verlo bien, vemos que es muy poco lo que se ve de los objetos, por tanto lo dejaremos en 1024.

Aplicaremos MGC y una vez aplicado podremos ver el cambio usando las flechas del undo/redo o bien con Ctrl+Z/Ctrl+Y, tal que así:

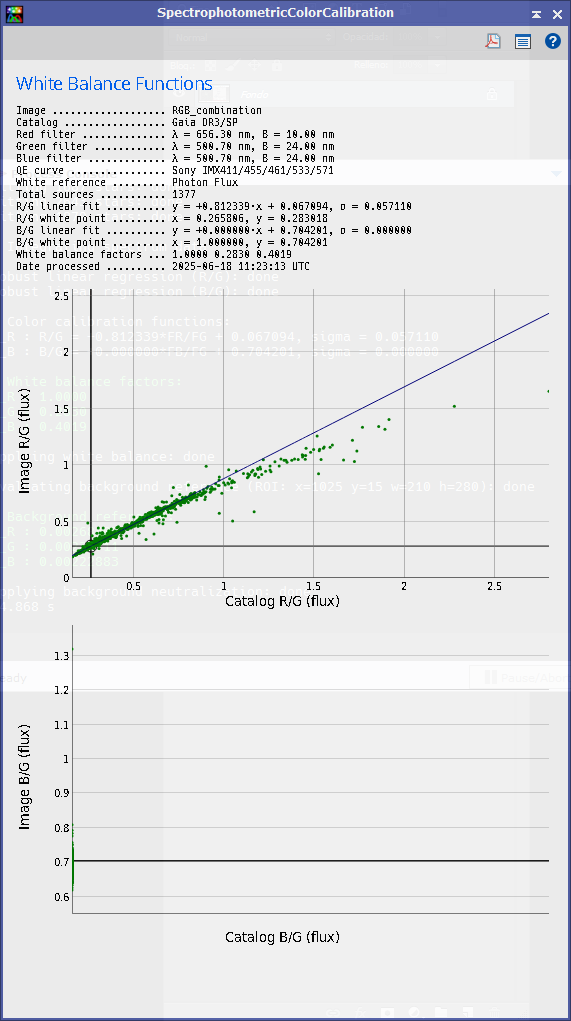

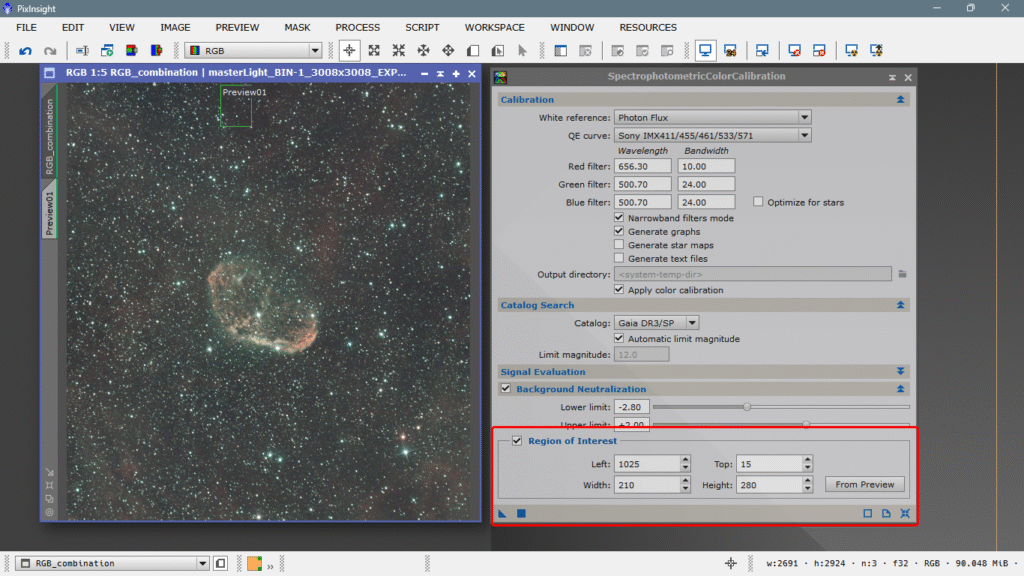

Como nos gusta el resultado, lo damos por bueno y pasamos al siguiente paso, la calibración del color con SPCC SpectroPhotometric Color Calibration, que aún no tiene una entrada propia, pero está explicada someramente dentro de la entrada del procesado lineal LINK

Y una vez se abra la consola, configuramos los parámetros de manera similar a como hemos hecho anteriormente con SPFC

La referencia de blancos la podríamos dejar perfectamente en Average spiral galaxy, ya que todas las estrellas son de nuestra galaxia y una media de un buen puñado de galaxias espirales, como es nuestra Vía Láctea, sería correcta, pero en este caso como el campo no es demasiado grande y tenemos bastante resolución (2.17″ arc/px), y además usamos un filtro de banda estrecha, elegiremos Photon Flux, ¿por qué?, porque como tenemos dos líneas de emisión bien definidas (Ha/OII) pues queremos que iguale el flujo de fotones entre las dos. Hay que decir que esto no es de obligado cumplimiento, pero al ser banda estrecha podemos elegir otra forma de calcular la referencia de blancos. También lo pondremos en modo banda estrecha e introduciremos el valor en nanómetros que hemos visto en la entrada del SPFC referente al filtro L-eNhance de Optolong, es decir, 10 nanómetros para el Ha (canal R) y 24 nanómetros para el OIII (canal G y canal B). El preview para la calibración de la media del fondo, y como no estamos demasiado seguros de que sea una zona libre de nebulosidad, pues elegiremos el trozo más oscuro que encontremos, no importa si tiene estrellas, lo más importante es que sea lo suficientemente grande y libre de nebulosidad para poder calcular unas estadísticas robustas. Tal que así.

Aplicamos y esperamos a la gráfica, que es la que nos dirá si hemos calibrado bien o no, la gráfica ideal estaría representada por muchos puntos verdes pegados o muy cerca de la línea azul, que representaría el ideal de GAIA, como podemos ver, tenemos muy poca desviación en los canales R y G, comparados con los canales R y G del catálogo DR3/SP de GAIA, la gráfica de abajo es plana porque tanto B como G son la misma imagen.

Pues bien, ya tenemos la calibración del color hecha, el siguiente paso para mí, es la corrección de la forma de las estrellas. Antes no lo hacíamos porque era prácticamente imposible o muy costoso y laborioso usando máscaras de estrellas y deconvolución, transformaciones morfológicas, y, sin embargo, los resultados no compensaban la pérdida de tiempo y de recursos, el mejor camino era disponer de una buena óptica y una buena montura, que estuviera totalmente libre de aberraciones, tanto cromáticas como geométricas, y en el caso de la montura, que nos hiciera seguimientos perfectos o casi perfectos, todo esto se traducía en ópticas y monturas clarísimas y que no estaban al alcance de todos los bolsillos, hablamos de decenas de miles de euros. Afortunadamente, las cosas han cambiado con la irrupción de la inteligencia artificial, no quiere decir que la IA se invente las cosas, simplemente hace una cosa parecida a lo que hacíamos antes, pero con muchísima más velocidad, exactitud y destreza.

Entre las herramientas de terceros, destaca la suite de Russell Croman y su famosa suite de los «XTerminators», LINK

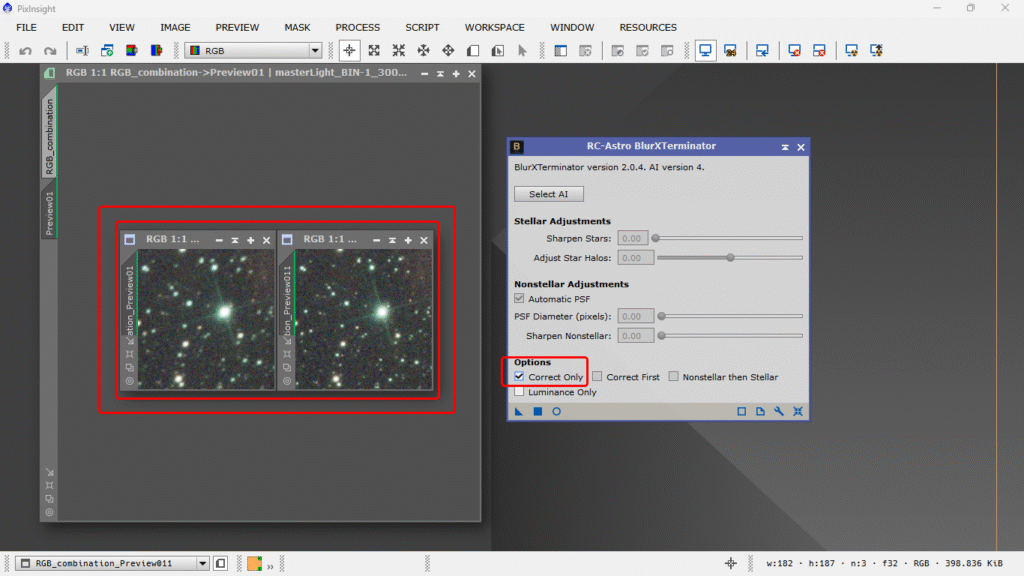

BlurXterminator

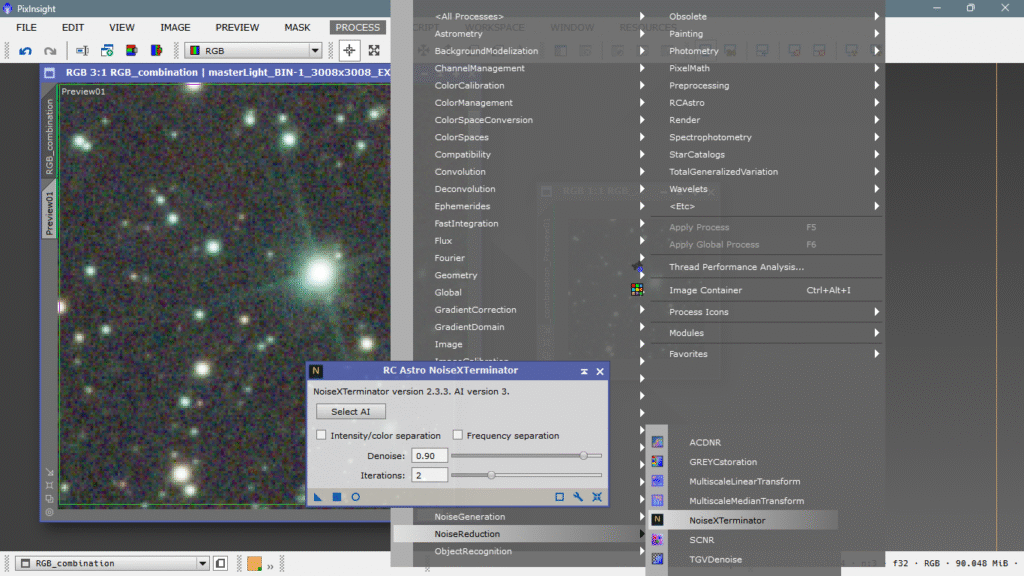

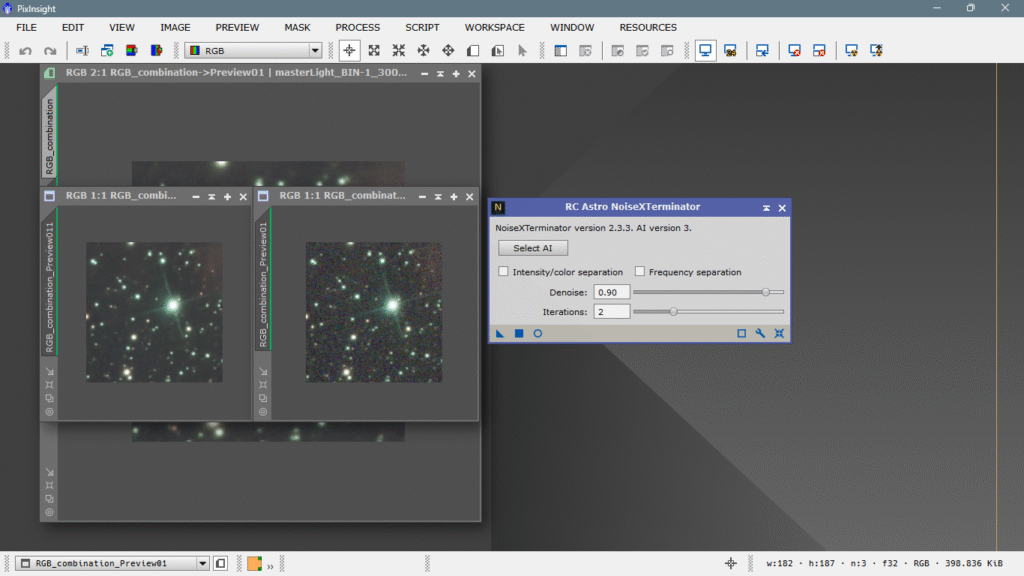

NoiseXTerminator

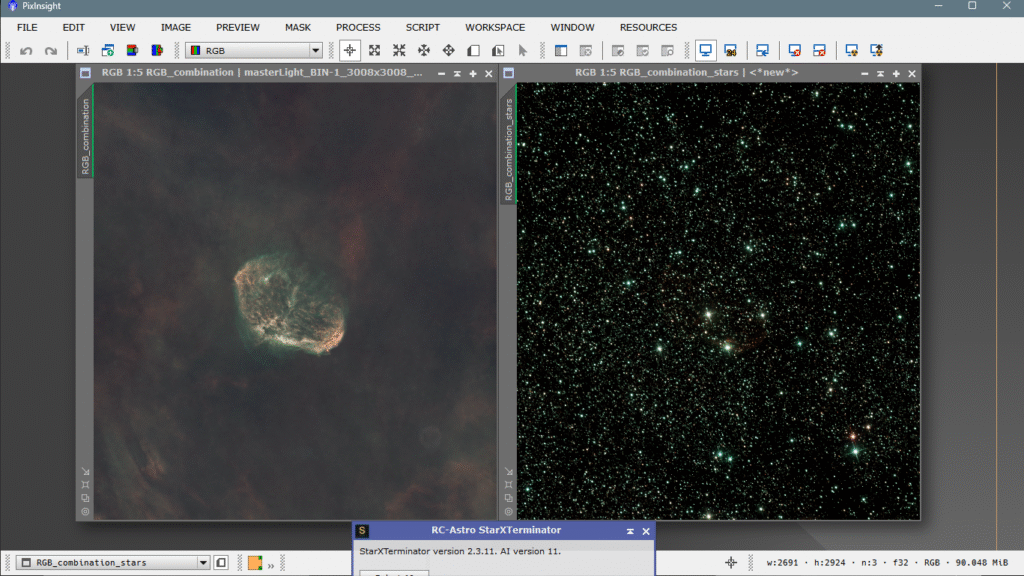

StarXTerminator

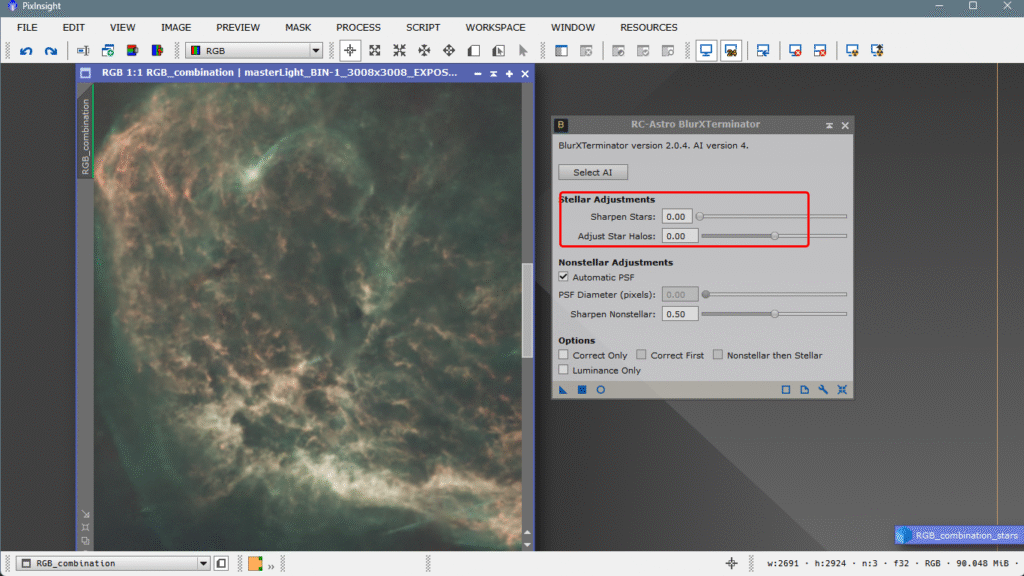

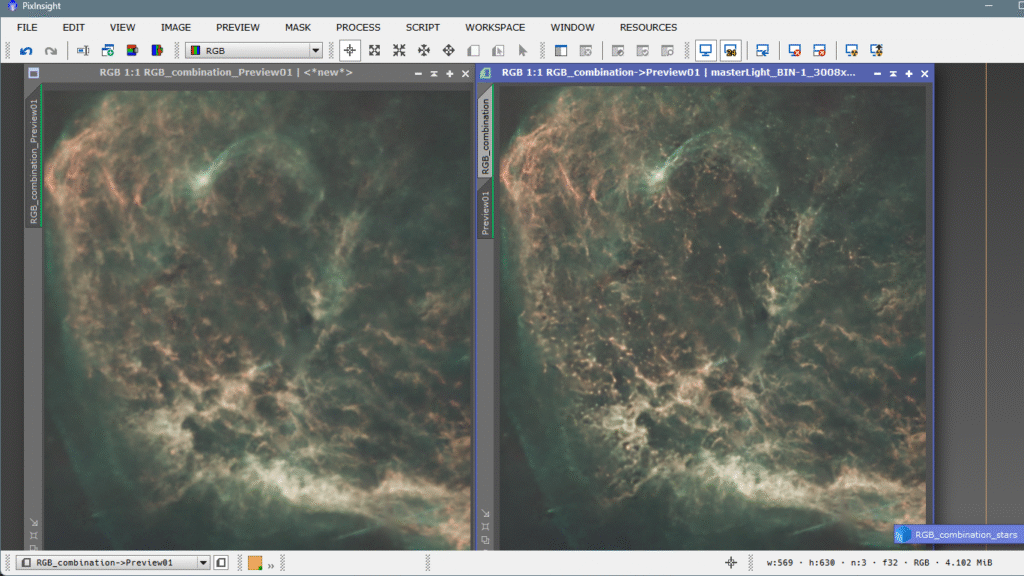

Son módulos de PixInsight provistos por un tercero, lo cual quiere decir que pueden ser gratis o bien de pago, como es el caso. Bien, centrémonos en el BlurXTerminator, que podemos describirla como una deconvolución avanzada, tiene varios parámetros y formas de trabajo, elegiremos el modo «Correct Only» que lo que hace es una transformación morfológica de las estrellas que puedan estar alargadas por fallos de seguimiento o por aberración geométrica de la lente o espejo y hacerlas redondas que es lo que todo el mundo quiere. Abrimos la herramienta y seleccionamos «Correct Only» y aplicamos, no sin antes sacar un preview para comparar el antes y el después, vale la pena los 87 € que vale la licencia.

En el preview de la derecha podemos ver las estrellas de las esquinas del newton, bien corregidas, en el de la izquierda es como eran antes de aplicar el BlurXTerminator en modo «Correct Only»

El siguiente paso sería hacer una reducción del ruido de pequeña escala, yo lo hago usando otra herramienta de inteligencia artificial, pero se puede hacer perfectamente de manera manual, lo explico en estas dos entradas LINK1 LINK2, en el primer enlace explico cómo fabricar la máscara, y en el segundo enlace cómo proceder y sacar el ruido.

Ahora lo haré mediante NoiseXTerminator, también de RC-Astro. Abrimos la herramienta y aplicamos por defecto, no hace falta máscara protectora, la red neuronal lee las estadísticas y determina qué es ruido y qué es señal, deshaciéndose de lo que es malo y conservando lo que es bueno (mas o menos je eje).

PS: Los parámetros por defecto son los que mejor trabajan en la mayoria de los casos, en imagenes «normales», en imnagenes de altisima profundidad, conviene hacer pruebas para no eliminar datos valiosos del fondo. Se ha comprobado que en imagenes profundas, por ejemplo el BlusXTerminator con la PSF por defecto, tiende a eliminar pequeñisimos detalles valiosos como puedan ser galaxias minusculas o frentes de nebulosa, nebulosas planetarias diminutas, etc, Por lo que convendria hallar de forma manual la PSF ideal.

(fuente: Pepe Bosch/Jaume Zapata).

Aplicamos y comparamos entre previews, la diferencia es notable

Bien, a continuación separaremos las estrellas de la nebulosidad, usaremos el otro as que faltaba del trío, el StarXTerminator.

Lo abrimos, seleccionamos Generate Star Image, y la IA se encargará de apartar las estrellas a una imagen donde solo estarán ellas y parte del fondo más oscuro, todo lo demás quedará en la imagen principal. Ahora tenemos dos imágenes, una con toda la nebulosidad y otra con las estrellas y el fondo más oscuro.

Y ahora es cuando podemos deconvolucionar las nebulosas, normalizar las estrellas a algo que se asemeje más a estrellas normales RGB y afinarlas un poquito más, entonces abriremos otra vez BlurXTerminator, pero esta vez no seleccionaremos nada, simplemente aplicaremos los parámetros por defecto a las nebulosas y compararemos el antes y el después. Hemos tenido la precaución de desactivar el parámetro Sharpen Stars poniéndolo a cero, ya que si no lo hacemos puede coger detalles pequeños, confundirlos con estrellas pequeñas y crear artefactos.

El cambio es sustancial.

Ahora toca estirar, desalinear la imagen, hay innumerables maneras de hacerlo, yo personalmente le tengo mucha fe al MS o Masked Stretch, un estirado que en cada iteración que hace, coloca una máscara para proteger las zonas más iluminadas, hablamos de esto en una entrada del FOSC. LINK

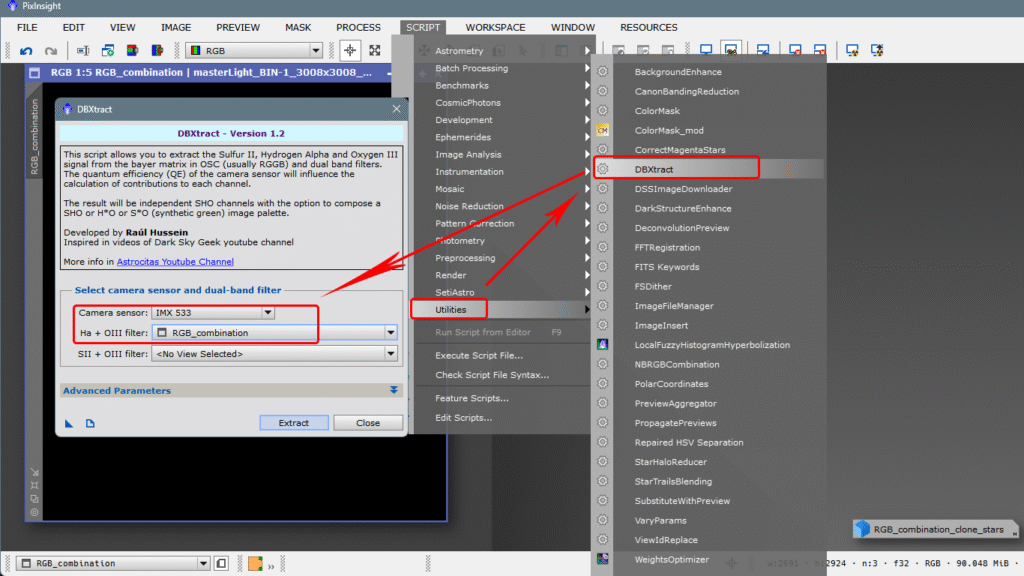

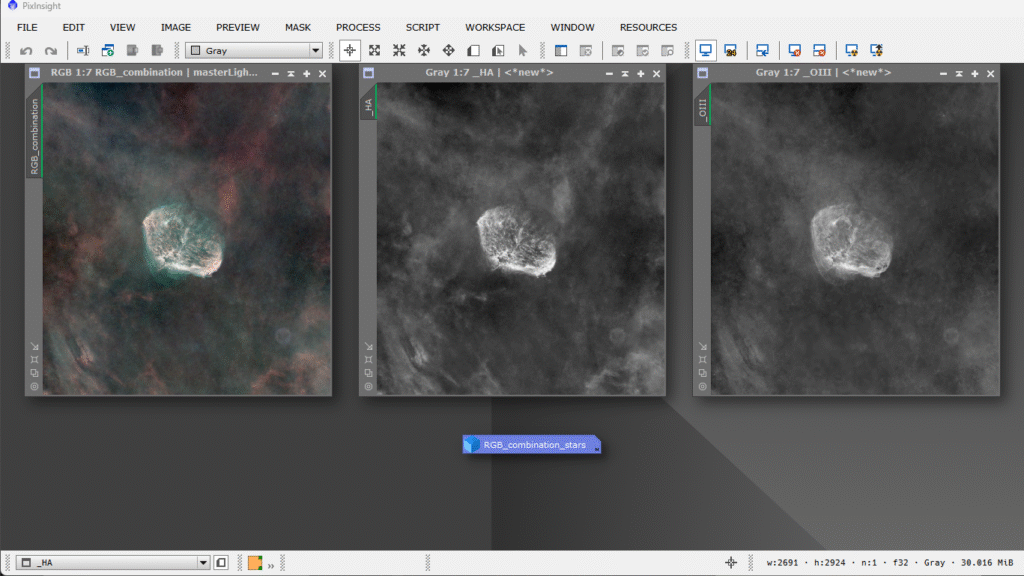

Antes de estirar, y como es una imagen de solo dos colores, extraeremos el canal Ha y el canal OIII con un script del amigo Raul Hussein que es un crack en estos menesteres, el script en cuestión es el famoso DBxtract que nos separará la línea de emisión del Hidrógeno alfa de la línea de emisión del Oxígeno III, simplemente abrimos la consola, ponemos el modelo de sensor y cuál es la imagen a separar, como solo tenemos una, le ponemos esa.

Pulsamos en Extract y nos sacará dos imágenes, la de Ha y la de OIII, las estiramos con STF para ver cómo son. Como podemos comprobar, hay diferencias más que sutiles entre las dos imágenes, las estructuras que sabemos son de OIII están bien representadas en la imagen pertinente, y las de Ha igual, obviamente la de Ha tiene más señal por el hecho de que el objeto es mayoritariamente Ha y está ubicado en una zona rodeada del mismo gas, el OIII, por contra, es más escaso, hay menos señal y por tanto más ruido, pues bien, con estas dos imágenes componemos nuestra nueva imagen, aunque guardaremos la imagen original por si la necesitamos más tarde y le haremos una pequeña reducción de ruido a la de OIII con NoiseXTerminator como hemos hecho antes.

Y hasta aquí habríamos hecho todo el procesado LINEAL, en el siguiente capítulo, veremos la parte no Lineal, los estirados de las luminancias y la combinación de canales para sacar unos u otros colores.

Hasta el próximo capítulo.